Scène 3

De la traduction simultanée au surtitrage

par Isabelle Schwartz-Gastine

La plus grande ouverture du théâtre français d’après-guerre aux accents venus d’ailleurs est allée de pair avec l’accueil d’un nombre plus important de spectacles créés dans des langues inconnues du public. Différentes modalités de traduction ont donc été explorées dès les années 1950.

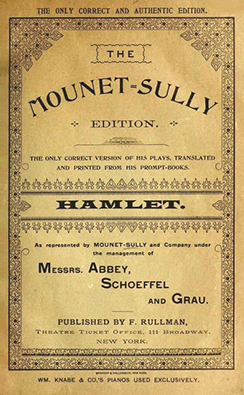

Lorsque des compagnies ou des grands comédiens donnaient des représentations théâtrales dans des pays étrangers, les spectateurs n’avaient d’autre choix que de se documenter avant la représentation et de se fier à leur culture littéraire et artistique. Lors des grandes tournées internationales, des éditions spéciales du texte en version unilingue ou bilingue pouvaient exceptionnellement être publiées. Par exemple, lorsque des acteurs anglais sont venus donner Romeo et Juliette et Hamlet en 1827 au Théâtre de l’Odéon à Paris, des livres en édition bilingue incluaient un portrait de l’actrice Harriet Smithson qui deviendra l’égérie d’Hector Berlioz. De la même façon, lors de sa tournée transatlantique en 1894, Mounet-Sully avait fait publier une version bilingue, vendue au Théâtre de Broadway à New-York et correspondant à son interprétation de Hamlet, la scène finale divergeant de l’original.

Du support papier à la technique de sonorisation

Lorsque la salle de spectacle fut plongée dans l’obscurité avec l’avènement de l’électricité modulable, à la fin du XIXe siècle, il devint impossible pour le spectateur de lire un livre posé sur ses genoux durant la représentation. Les théâtres fournissaient un résumé de l’action, acte par acte, que l’on pouvait parcourir rapidement avant le spectacle ou à l’entracte. Ce système a perduré pendant longtemps, il est même parfois toujours en vigueur.

Depuis le milieu du XXe siècle, la technologie a commencé à investir les salles de spectacle. Le Théâtre des Nations a bénéficié d’un système de traduction simultanée à partir de la saison 1960, les spectateurs pouvaient emprunter gratuitement un petit transistor sans fil relié à des écouteurs. C’était un système optionnel, qui ne gênait pas les autres spectateurs. La traduction n’était pas enregistrée. Tout était retransmis en direct.

Les compagnies invitées devaient fournir leur texte à l’avance, le service littéraire du Théâtre des Nations se chargeait de la traduction, assurée à partir de trois langues : anglais, allemand, espagnol. Mais souvent, il fallait faire dans l’urgence de la représentation, sans traduction préalable, en ayant pris connaissance du texte peu de temps avant la représentation ce qui représentait des difficultés pour l’allemand puisque le verbe se place en fin de proposition.

La retransmission était d’abord assurée par des « lecteurs » professionnels, comme lors des conférences internationales, par exemple celles de l’UNESCO, ou lors du Procès de Nuremberg, puis par des speakers de radio bilingues ou des comédiens recrutés spécialement. Ces derniers étaient installés près de la scène dans une loge transformée en cabine technique. Ils voyaient le spectacle et pouvaient moduler leur débit en fonction de l’action scénique. Isolés et enfermés dans une cage de verre, ils ne dérangeaient pas les spectateurs placés à côté, même si ceux-ci se plaignaient parfois de grésillements intempestifs dus à la technique.

En 1960, dix-neuf spectacles sur les vingt-quatre présentés ont bénéficié d’une traduction simultanée. Devant le succès de cette innovation, dès 1961, les vingt spectacles furent traduits. Ce système a perduré au Théâtre Sarah Bernhardt jusqu’en 1965, et s’est poursuivi au Théâtre de l’Odéon de 1966 à 1971. Certains praticiens ne furent pas favorables à cette nouvelle technique, arguant du fait que le continuum sonore était l’une des composantes du spectacle, et que cette pratique faisait écran entre la scène et le spectateur. Helene Weigel a ainsi refusé que les quatre spectacles donnés par le Berliner Ensemble durant la saison 1966 à l’Odéon soient traduits.

Le Théâtre national de Chaillot fait figure de pionnier. En 1977, pour les trois représentations du Hamlet mis en scène par Iouri Lioubimov, la salle fut équipée d’écouteurs à deux oreillettes accrochés au dos des dossiers de la rangée précédente et mis gratuitement à la disposition des spectateurs. Tous les écouteurs diffusaient le même texte, présenté dans le programme comme étant la version française d’André Gide. Le spectateur pouvait mettre le casque, ce qui lui permettait de ne pas déranger ses voisins, il pouvait couper le son à sa guise et se laisser guider par le flot de la langue russe, ou bien encore n’écouter la version française que d’une oreillette et profiter également de l’original. Évidemment, ce système avait ses défauts, ce n’était pas vraiment la traduction du texte en russe déclamé par les acteurs, mais une traduction tout aussi littéraire que celle de Pasternak. La synchronisation ne pouvait pas être exacte, puisque les deux auteurs-traducteurs avaient pris des libertés avec le texte de Shakespeare. Les coupes ou les ajouts, indicateurs d’options scéniques affirmées de la part du metteur en scène n’étaient pas non plus pris en compte : en particulier, au début et à la fin de la représentation, les chansons interprétées à la guitare par Vladimir Vyssotski, chanteur contestataire très connu à la ville, qui incarnait Hamlet, ou bien les commentaires des fossoyeurs, pétris d’allusions à la vie soviétique contemporaine.

Du sous-titrage du cinéma au surtitrage du théâtre

Prenant modèle sur le sous-titrage filmique, les théâtres ont commencé à s’équiper d’installations permettant d’offrir un aperçu littéral du texte sans couvrir le flot sonore émis par les comédiens. La mise en place d’un tel système n’était cependant pas à la portée financière et technique de tous les théâtres. Il nécessitait un investissement non seulement matériel mais aussi humain : un « technicien son » était indispensable avant et durant toutes les représentations. Les machines étaient lourdes et coûteuses, et certains théâtres qui en avaient fait l’investissement proposaient de les prêter ou de les louer à d'autres. De plus les systèmes d’exploitation ne permettaient l’affichage que d’une ligne ou deux à la fois, chaque ligne étant composée d’un nombre limité de signes.

À présent, la projection par Power Point est beaucoup plus facile à gérer. C’est le système utilisé par le metteur en scène québécois Robert Lepage depuis la fin des années 1990, lui permettant d’être complètement indépendant des contingences matérielles des différents lieux où la compagnie se produit. Les diapositives du Power Point peuvent être lancées à tout moment, des modifications de texte peuvent être intégrées à la dernière minute. Le texte peut être projeté sur toutes sortes de supports (murs de scène, montants de manteau d’arlequin, draperies…). De nombreux théâtres ont encore un écran (ou une plage de projection) au-dessus de la cage de scène d’où le texte est lisible de partout dans la salle. Il faut que le spectateur puisse embrasser l'écran de surtitrage et la scène dans un même champ visuel, sans fatigue corporelle supplémentaire. La non-lisibilité des surtitrages est signalée sur les schémas de salle (les premiers rangs), les prix étant souvent minorés en conséquence.

Aujourd’hui, la traduction simultanée est complètement oubliée, reléguée aux lointaines prémices de l’ère technologique ; le surtitrage l’a supplantée de manière définitive. Si bien que les spectacles en langue étrangère gardent toute leur saveur orale et que les spectateurs peuvent dorénavant suivre l’action scénique en comprenant le déroulement de l’intrigue. Ce système propose son lot de variantes : à l’Odéon-Théâtre de l’Europe par exemple, durant la saison 2017-2018, plusieurs spectacles étrangers ou français ont étés programmés en alternance avec des surtitrages anglais ou français.